中国唯一一家专业只做ARACLE认证和BDA实训的甲骨文金牌合作企业

1、搭建环境

部署节点操作系统为CentOS,防火墙和SElinux禁用,创建了一个shiyanlou用户并在系统根目录下创建/app目录,用于存放Hadoop等组件运行包。因为该目录用于安装Hadoop等组件程序,用户对shiyanlou必须赋予rwx权限(一般做法是root用户在根目录下创建/app目录,并修改该目录拥有者为shiyanlou(chown –R shiyanlou:shiyanlou /app)。

Hadoop搭建环境:

l 虚拟机操作系统: CentOS6.6 64位,单核,1G内存

l JDK:1.7.0_55 64位

l Hadoop:2.2.0 64位(该部署包为第2个实验所编译完成)

2、部署Hadooop2.X

2.1配置Hadoop环境

在Apache网站上提供Hadoop2.X安装包只支持32位操作系统安装,在64位服务器安装会出现3.1的错误异常。这里我们使用上一步骤编译好的Hadoop-2.2.0-bin.tar.gz文件作为安装包(也可以在/home/shiyanlou/install-pack目录中找到Hadoop-2.2.0.tar.gz安装包)

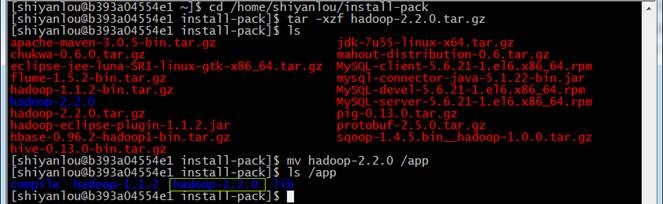

2.1.1 下载并解压Hadoop安装包

解压缩并移动到/app目录下

cd /home/shiyanlou/install-pack

tar -xzf Hadoop-2.2.0.tar.gz

mv Hadoop-2.2.0 /app

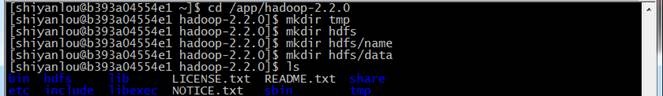

2.1.2 在Hadoop目录下创建子目录

在Hadoop-2.2.0目录下创建tmp、name和data目录

cd /app/hadoop-2.2.0

mkdir tmp

mkdir hdfs

mkdir hdfs/name

mkdir hdfs/data

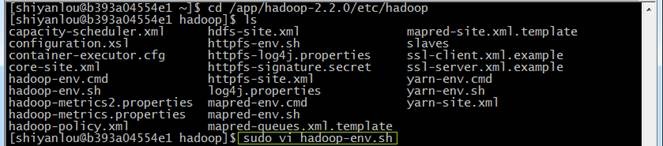

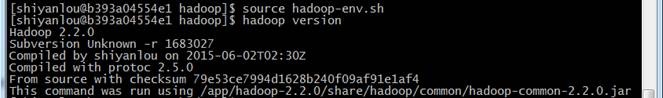

2.1.3配置Hadoop-env.sh

1. 打开配置文件Hadoop-env.sh

cd /app/hadoop-2.2.0/etc/hadoop

sudo vi Hadoop-env.sh

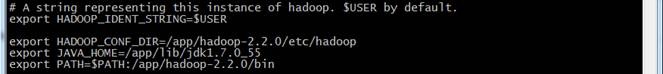

2. 加入配置内容,设置了Hadoop中jdk和Hadoop/bin路径

export HADOOP_CONF_DIR=/app/hadoop2.2.0/etc/hadoop

export JAVA_HOME=/app/lib/jdk1.7.0_55

export PATH=$PATH:/app/hadoop-2.2.0/bin

3. 编译配置文件Hadoop-env.sh,并确认生效

source Hadoop-env.sh

Hadoop version

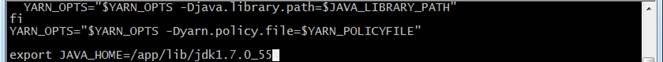

2.1.4配置yarn-env.sh

打开配置文件yarn-env.sh,设置了Hadoop中jdk路径,配置完毕后使用source yarn-env.sh编译该文件

export JAVA_HOME=/app/lib/jdk1.7.0_55

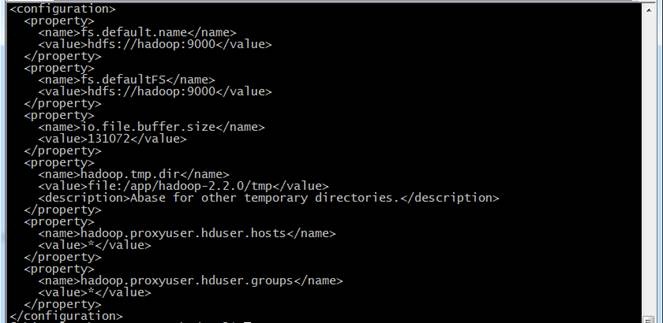

2.1.5配置core-site.xml

1. 使用如下命令打开core-site.xml配置文件

cd /app/hadoop-2.2.0/etc/hadoop

sudo vi core-site.xml

2. 在配置文件中,按照如下内容进行配置

<configuration>

<property>

<name>fs.default.name</name>

<value>hdfs://hadoop:9000</value>

</property>

<property>

<name>fs.defaultFS</name>

<value>hdfs://hadoop:9000</value>

</property>

<property>

<name>io.file.buffer.size</name>

<value>131072</value>

</property>

<property>

<name>Hadoop.tmp.dir</name>

<value>file:/app/hadoop-2.2.0/tmp</value>

<description>Abase for other temporary directories.</description>

</property>

<property>

<name>Hadoop.proxyuser.hduser.hosts</name>

<value>*</value>

</property>

<property>

<name>Hadoop.proxyuser.hduser.groups</name>

<value>*</value>

</property>

</configuration>

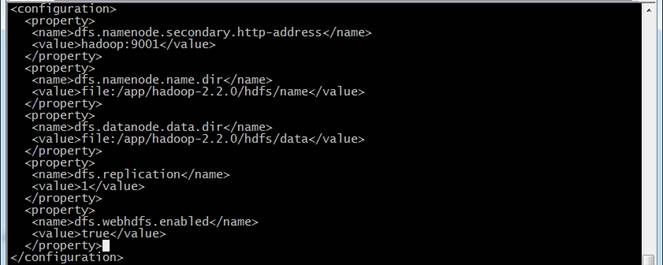

2.1.6配置hdfs-site.xml

1. 使用如下命令打开hdfs-site.xml配置文件

cd /app/hadoop-2.2.0/etc/hadoop

sudo vi hdfs-site.xml

2.在配置文件中,按照如下内容进行配置

<configuration>

<property>

<name>dfs.namenode.secondary.http-address</name>

<value>Hadoop:9001</value>

</property>

<property>

<name>dfs.namenode.name.dir</name>

<value>file:/app/hadoop-2.2.0/hdfs/name</value>

</property>

<property>

<name>dfs.datanode.data.dir</name>

<value>file:/app/hadoop-2.2.0/hdfs/data</value>

</property>

<property>

<name>dfs.replication</name>

<value>1</value>

</property>

<property>

<name>dfs.webhdfs.enabled</name>

<value>true</value>

</property>

</configuration>

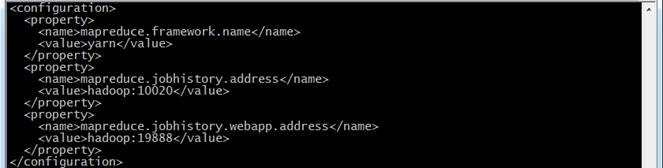

2.1.7配置mapred-site.xml

1.默认情况下不存在mapred-site.xml文件,可以从模板拷贝一份,并使用如下命令打开mapred-site.xml配置文件

cd /app/hadoop-2.2.0/etc/hadoop

cp mapred-site.xml.template mapred-site.xml

sudo vi mapred-site.xml

2.在配置文件中,按照如下内容进行配置

<configuration>

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

<property>

<name>mapreduce.jobhistory.address</name>

<value>Hadoop:10020</value>

</property>

<property>

<name>mapreduce.jobhistory.webapp.address</name>

<value>Hadoop:19888</value>

</property>

</configuration>

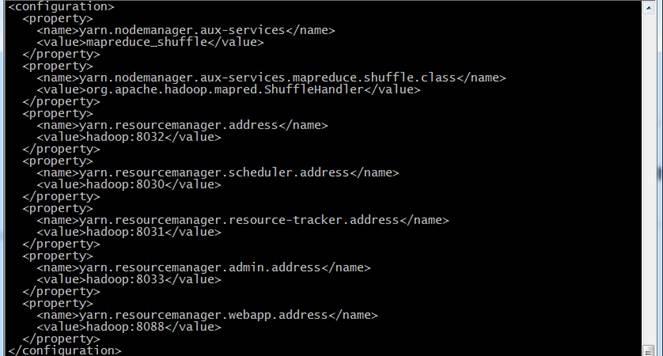

2.1.8配置yarn-site.xml

1.使用如下命令打开yarn-site.xml配置文件

cd /app/hadoop-2.2.0/etc/hadoop

sudo vi yarn-site.xml

2.在配置文件中,按照如下内容进行配置

<configuration>

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

<property>

<name>yarn.nodemanager.aux-services.mapreduce.shuffle.class</name>

<value>org.apache.Hadoop.mapred.ShuffleHandler</value>

</property>

<property>

<name>yarn.resourcemanager.address</name>

<value>Hadoop:8032</value>

</property>

<property>

<name>yarn.resourcemanager.scheduler.address</name>

<value>Hadoop:8030</value>

</property>

<property>

<name>yarn.resourcemanager.resource-tracker.address</name>

<value>Hadoop:8031</value>

</property>

<property>

<name>yarn.resourcemanager.admin.address</name>

<value>Hadoop:8033</value>

</property>

<property>

<name>yarn.resourcemanager.webapp.address</name>

<value>Hadoop:8088</value>

</property>

</configuration>

2.1.9配置slaves文件

在slaves配置文件中设置从节点,这里设置为Hadoop,与Hadoop1.X区别的是Hadoop2.X不需要设置Master

cd /app/hadoop-2.2.0/etc/hadoop

vi slaves

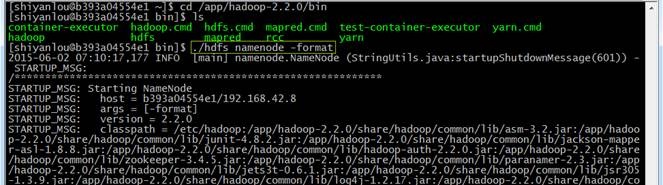

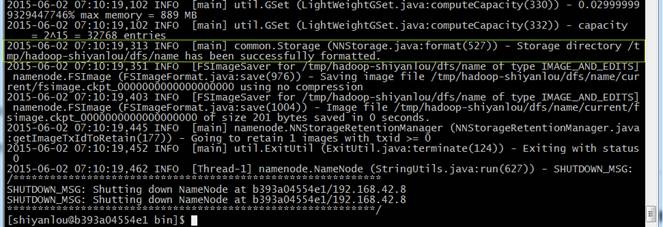

2.1.10格式化namenode

cd /app/hadoop-2.2.0/bin

./hdfs namenode -format

2.2启动Hadoop

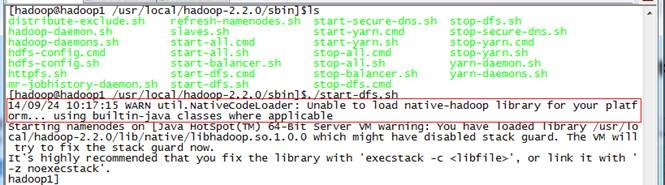

2.2.1启动hdfs

cd /app/hadoop-2.2.0/sbin

./start-dfs.sh

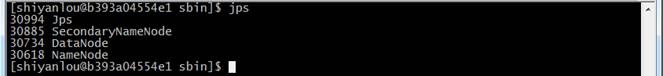

2.2.2验证当前进行

使用jps命令查看运行进程,此时在Hadoop上面运行的进程有:namenode、secondarynamenode和datanode三个进行

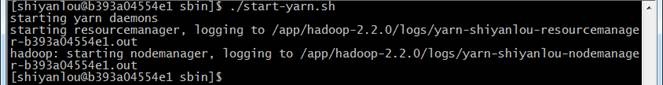

2.2.3启动yarn

cd /app/hadoop-2.2.0/sbin

./start-yarn.sh

2.2.4验证当前进行

使用jps命令查看运行进程,此时在Hadoop上运行的进程除了:namenode、secondarynamenode和datanode,增加了resourcemanager和nodemanager两个进程:

2.3测试Hadoop

2.3.1创建测试目录

cd /app/hadoop-2.2.0/bin

./hadoop fs -mkdir -p /class3/input

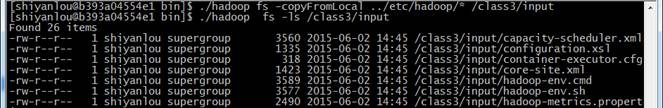

2.3.2准备测试数据

./hadoop fs -copyFromLocal ../etc/hadoop/* /class3/input

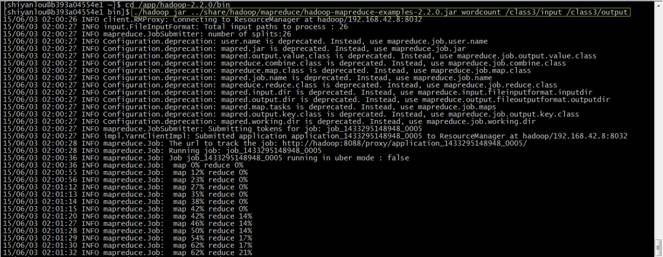

2.3.3运行wordcount例子

cd /app/hadoop-2.2.0/bin

./hadoop jar ../share/hadoop/mapreduce/hadoop-mapreduce-examples-2.2.0.jar wordcount /class3/input /class3/output

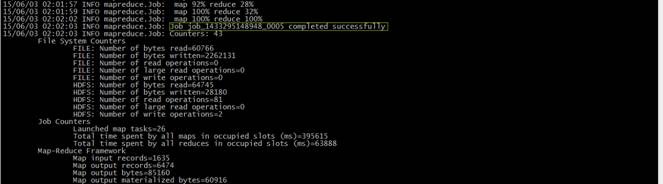

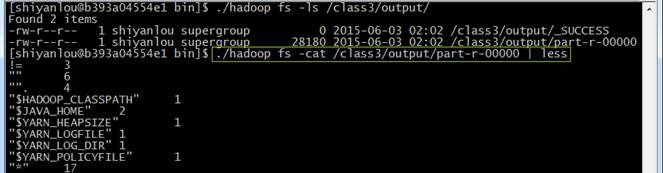

2.3.4查看结果

使用如下命令查看运行结果:

./hadoop fs -ls /class3/output/

./hadoop fs -cat /class3/output/part-r-00000 | less

3、问题解决

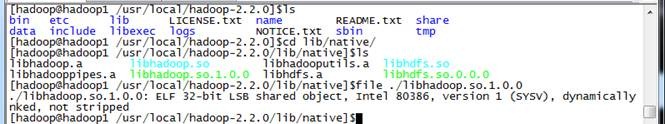

3.1CentOS 64bit安装Hadoop2.2.0中出现文件编译位数异常

在安装Hadoop2.2.0过程中出现如下异常:Unable to load native-Hadoop library for your platform... using builtin-java classes where applicable

通过分析是由于lib/native目录中有些文件是在32位编译,无法适应CentOS 64位环境造成

有两种办法解决:

l 重新编译Hadoop,然后重新部署

l 暂时办法是修改配置,忽略有问题的文件

CUUG 优技培训

CUUG -CHINA UNIX USER GROUP,是国际UNIX组织UNIFORUM的中国代表,是国内悠久的专业UNIX培训机构,被誉为中国UNIX 的摇篮。

CUUG -CHINA UNIX USER GROUP,是国际UNIX组织UNIFORUM的中国代表,是国内悠久的专业UNIX培训机构,被誉为中国UNIX 的摇篮。金牌讲师

实操环境

院校合作

学校新闻

行业新闻

请输入您的手机号

申请试听